そのため撮影機材のハード寄りの情報をまとめてみました。

360度写真撮影はデジイチでなくてもiPhone/Androidスマホや RICOH THETA等、選択肢はたくさんありますがここでは一眼レフで素材を撮影するケースについて取り上げます。

※THETAのようなワンショット機材は他にもいくつかありますし、iris360等ワンショットでもやや高解像度を狙った製品もあります。

この記事はとても長いです。

関心ある方対象に360度写真撮影のための機材セッティングから撮影までを一気に書いています。

撮影以降の合成作業については、今はソフトの選択肢もたくさんあるので使い方などはそれぞれ詳しく書かれているサイトの方をご覧下さい。ソフトの数もたくさんあるのでここでは流れだけを簡単に紹介するだけにしておきます。

ここからスタート

まずはじめに… デジタル一眼を使っての360度写真撮影は難しくはありません。

もちろんレンズや専用のパノラマヘッド(雲台)の調達・撮影後の作業に使うソフト・ツール云々など面倒な部分はありますが、 とりあえず…お使いのカメラ&レンズ(Fisheye)を基に、、その組み合わせに調整されたパノラマヘッドを入手。 あとはスティッチソフトの入手で殆ど終了します。そして始めるだけ^^

もちろん調整・設定の仕方など、やや複雑な部分はありますがその多くは写真技術ですから一眼レフで写真撮ってる方なら普段から意識している部分にかぶりますし、わりと察しが付くものばかりだと思います。

この記事で紹介するのはFisheyeを使った簡易撮影ですが、この基本スキルがあれば、一般的な広角〜標準レンズを使った仰俯角多面撮りの方法・雲台の作り方もイメージできるようになります。

と、いうわけでここ記事ではパノラマヘッドの自作の方法を含め、その解説をやっておきます。

市販のパノラマヘッドを使う場合は全く必要のない情報なのですが、リクツを知るために一応読んでみてください。

尚、私自身は今はGoogleローカルガイドのための撮影をメインに行っていますが、あくまで個人活動。

ここでは一般的な360度写真の撮り方の説明ですが、商業撮影でもやることは変わりません。

VR・360度写真・全天周・全天球…と呼び方がたくさんありますが、以下PhotoSphereと表記します。

少し歴史

PhotoSphereは以前は単にVRと呼ばれていました。

1995年(QuickTime2.0)の時点では水平方向360°のみのシリンダー状で、その後のQuickTime3でCubicVRが組み込まれたあたりから各種ソフトウェアが出回るようになったと記憶しています。(QuickTime5で安定度が上がりました)

市販のデジカメ+Fisheyeレンズの組み合わせで素材撮りできるようになったのはこの頃です。

Cubic以前はリニアCCDスキャンカメラ(回転しながら数千〜2万回程度シャッター切ります)で一気に数十〜200Mピクセル程度のEquirectangular (正距円筒図法)を撮影出力する力技手法ですけれど、強烈なスミアの発生や撮影を行うプロセス上の問題(制約)のため使用シーンが限定されました。リニアCCDスキャンカメラは個人的には5機種使用・評価しています。

カメラとレンズ

私自身過去に試したことのあるもので意外さがあるのは… 写ルンです使っての360度写真撮影。手持ち&失敗の許されない限られたフィルム枚数のもと…とても苦労しますができないことはありません。

つまりその気になれば何でも使えルンです。

そんな具合に実のところレンズはこれでなくちゃいけないというものはありません。

8ミリ、15ミリ、24ミリ… 標準やそれ以上の焦点距離でも良いのですが、円周魚眼以外では仰俯角多面撮りという手法に変わりますからパノラマヘッドが異なります。そこは注意が必要です。

この記事では最もポピュラーな8ミリなどの円周魚眼(Fisheye)を前提として解説します。

魚眼レンズですが、この10年以上最もよく使われているのはシグマの円周魚眼です。

円周魚眼はCIRCULAR FISHEYEと表記されています。

対角魚眼(DIAGONAL FISHEYE)と間違えないようにして下さい。

さしあたり円周魚眼であればいいので他メーカーにも使えるものがあります(例えばNikkor 6mm F2.8等)が、先ずは全方向180度以上の画角視界が得られるものである必要があります。

デジタル一眼レフはミラーレスも含め何でも良いと思いますけれど、カメラ・レンズについて次の点は気に留めておいて下さい。

●円周魚眼レンズが理想(対角魚眼は撮影方法とその後の処理の面でかなりハードルが高くなります)

●カメラはワイヤードリモコン・WiFiリモコンが使えること(赤外線ワイヤレスでも良いですが正面に受光窓があるのはNG)

●PhotoSphere素材撮りはブラケティング撮影を行います。(つまりHDR)

●フルサイズでも構いませんがイメージサークルが欠けるAPS-Cの方がちょっとだけ都合が良い※3です。

※1

撮影という意味では先にあげた写ルンですは極端ですがフィルム一眼でも当然OKですしコンデジ+フィッシュアイコンバーターが一般的だった頃に試しで何度か使ってみましたけれど、問題はその場での確認ができない・フィルム枚数との戦い・現像〜データ化工程が入るためかなり不便です。

※2

今のAPS-Cデジイチでしたら何を使っても画角180度の円周魚眼使用で横8000×4000ピクセル以上のEquirectangular画像が作れますが、更に高解像度化を目指すのでしたら実際にはレンズの焦点距離はどのくらいでもOKです。(画質を上げるためには焦点距離を長く・・画角を狭くして素材枚数を多くします。)私自身50ミリを使って30660×15330ピクセルでPhotoSphereを作ったことがあります。

これは仰俯角多面撮りと言いますが、主に精細さを求める際の撮影方法です。

この場合水平方向以外に数段階の縦フリも含めることになるので1ノード撮影に60カット×3(HDR)以上必要になります。

尚、歴史のあるQuickTime系列で10年以上前の基準ですが10pixels/deg以上がCubicVRと一応最低値が設定されています。

※3

円周魚眼をAPS-Cで撮ると欠けますが、それだけ拡大されて写せるとことを意味します。単純に解像度だけの比較で言うと、同一解像度のフルサイズ対APS-Cでは画面いっぱいに絵が写りこむAPS-Cの方が若干メリットがあります。

もちろん純粋に画質としてのバランスで見るとフルサイズの選択は間違いではありませんが、PhotoSphere撮影にフルサイズ使うクオリティを求める場合は円周魚眼装着で少枚数で…という選択は少ないと思います。

フルサイズ+円周魚眼の組み合わせで考えられるケースとしては普段一般撮影など別用途に使っているフルサイズをそのままPhotosphere撮影にも活用するという事情のものだと思います。

※4

円周魚眼での水平方向◯枚撮りは、全方位360度写真を撮る方法としては極めて簡易な方法であることは意識しておいて下さい。年々カメラの性能が良くなり解像度もあがってきていますが、円周魚眼を使っている限りではやはり簡易撮影の範疇から出ません。特に周囲に多く発生する倍率色収差は避けられないのである程度画質を諦める必要もあります。

(一応、現像ソフトのSILKYPIXにはこれを補正する機能はあります)

一方、周囲◯面撮りだけで良いということは人や車の行き交いがある場所での即撮りメリットがあります。

-----------------------------------------------------------------------------------------------------

その他必要部材

カメラ・レンズ以外に必要になるものは次の通りです。

●VRヘッド(パノラマヘッド)

カメラを据え付ける架台のことですけれど、下に示すように市販品がいくつか出ています。

そういう製品は厳密に対応カメラ&レンズを指定(組み合わせを選択して購入)することになるので注意して下さい。

対応範囲の広い(自分で調整を行う前提の)ものやカメラ屋さんで手に入る汎用パーツを組み合わせて自作もできます。その際の方法は後ろのほうで書きます。

GoogleでPhotoSphere撮影向けとして紹介されているものは次の製品です。

Nodal NinjaR10

Acratech Spherical Panoramic Head

tomshot360

360Precision

これらの製品は以下に説明する回転台付きのものもあります。

おそらく殆どの方はこういう既製品で機材を揃えてしまうことになるでしょうし効率が良いと思います。

ここから下で解説している内容を知らなくても多分大丈夫だと思いますけれど、何故こういうセッティングになるのかを理解されたい方は読み進めてください。

●回転台(panoramic Rotation unit)

VR Headを回転させるために下(三脚・レベラーとの間)にこれに取り付けます。

PhotoSphere素材撮りは1周を最低4分割して撮影しますが、決まった角度のところでカチッ…っと止まる構造になっているものが便利です。ストップ機構がない場合は目盛りを見ながら合わせるか目盛りすら見ずに目分量合わせという方法もありますが今のソフトなら多少ズレていても合成できますから回転するのなら何でも良いです。Manfrotto 300N などは自由に分割数の設定できます。

使うレンズの焦点距離が長くなるほど高解像度になりますが、それは同時に細かいステップ(分割)で撮影することを意味します。

2000年台初頭Fisheyeで前後の2面撮りもよく使われる手法でしたが画質に難ありでした。

●レベラー・レベリングユニット

水平出しのために使いますが三脚でもそれなりに調整できますしソフト側で水平出しもできるので必須ではありません。 でもこれがあると便利です。

撮影時にできるだけちゃんとした絵をとっておくと、あとの作業効率にプラスになりますから機材を揃えるところから始める方は揃えておくと良いと思います。

|

| レベリングユニットManfrotto 438 + ローテートユニットManfrotto 300N |

三脚から上の部分は比較的重たくなるので三脚はしっかりしたものを使って下さい。

上記レベラー・回転台・パノラマヘッドを別途取り付ける為、できれば雲台セットではないものが理想です。

●クイックシュー

PhotoSphereの撮影でなくても普通に使用するものですが、手持ち地軸(真下)撮影まで行う場合は迅速さが要求されますので必須です。

また、下の方で解説している内容をご覧いただくと気付くと思いますが、位置関係がシビアですからクイックシューはカメラセット時には遊びのないガッチリしたものが必要となります、

|

| Manfrotto #625六角形プレートアダプター クイックリリースプレートシステム |

●バブル水準器

必須というわけではありませんが、1脚もしくはレベリングユニットを使って撮影時に水平出しをするならば必要です。

クイックシューバブル水準器等もありますが、これはパノラマヘッドの構造的な問題から撮影効率を落としてしまうので、できれば回転軸線上に設置できるものを選んで下さい。

| 三脚の上にレベラーや回転ユニット…パノラマヘッド・水準器を取り付ければ撮影機材としては完成です。 随所にクイックシューを取り付けておくと良いです。 |

|

| レベラーManfrotto 438使用 | レベラー代用に通常雲台を流用したもの。 |

|  |

撮影時の安定度は極端に低下するのでオススメという意味ではありませんし私は普段この方法を避けていますが撮り方の方法の一つとしてはアリだと思います。

※4分割撮影程度でしたら回転台・レベラー・レベリングユニットを省いて1脚で…という簡易な手段も有効です。この場合は垂直傾きに気をつけるため水準器を凝視しながら4面撮影します。但しHDRは無理です。

|

| 【1脚セット】 取り付けてるカメラはPhotoSphere撮影用ではありませんが、1脚使う時はこういうリモコンを取手のとこに付けておくと便利です。 (半押し・全押しのためにスイッチ二つ付けてます) 1脚使用時は水準器のみを凝視して縦がズレないように注意しながら4カット撮るからですが、シャッターがその取手にあれば便利かなと思って作ってみました。 尚、この写真のセットには取り付けていませんが1脚撮影の場合でもパララックスエラー回避のためPanorama Head等は必要です。 |

※三脚を一切使わない錘ぶらさげ撮影という方法もありますが、ここでは割愛します。

また、GPSで角度を確認しながら素材撮りしていく等 色々あるのですが順番として先ずは素材の撮り方について、そうするリクツを把握してからこれらの手法を選択肢として取り入れていくのがいいと思います。

-----------------------------------------------------------------------------------------------------

下の写真は以上を踏まえて組み合わせた撮影セットです。

Fisheyeを使用しての水平6(4)面撮影のみは即撮りがメリットです。

24ミリ・50ミリ〜などを使用しての仰俯角多面撮りは高精細画像を得られます。

※この記事はFisheye使用時のセッティングに話題をしぼっているので仰俯角多面撮りの解説は行いません。

Fisheyeを使用しての水平6(4)面撮影のみは即撮りがメリットです。

24ミリ・50ミリ〜などを使用しての仰俯角多面撮りは高精細画像を得られます。

※この記事はFisheye使用時のセッティングに話題をしぼっているので仰俯角多面撮りの解説は行いません。

| 【狭い空間撮影用に作ったセット】 APS-Cカメラ 8ミリ円周魚眼 パーツ組み合わせVR-Head(三脚のことを考えて軽量化しています) 回転台(NOVOFLEX PANORAMA) 三脚(GITZO G0012Mk2) |

| 【持ち歩き用標準セット】 APS-Cカメラ(kiss Digital) 8ミリ円周魚眼 パーツ組み合わせVR-Head 回転台(Manfrotto 300N) 三脚(GITZO GT2540) |

|

| 【仰俯角多面撮りセット】※高精細撮影向け フルサイズカメラ(EOS 1Ds markII) 写真のは24ミリを装着した状態 VR-Head(Manfrotto 303SPH) 回転台(Manfrotto 300N) レベラー(Manfrotto 438) 三脚(HUSKY3段) |

-----------------------------------------------------------------------------------------------------

真上と真下

通常PhotoSphereの撮影は円周魚眼を使って水平方向4分割撮りで大丈夫です。

地軸(真下)付近に三脚や雲台が写りこみますが、殆どの場合はレタッチで埋めてしまえます。

但し、撮影現場によってはその地軸面も正確に撮り残す必要もあって、そういう場合はカメラを手持ちにして真下を写します。

当然自分の足元が画面に入りますが、スティッチの工程で他カットから持ってくる部分ですからそれはあまり気にする必要はありません。

上にある写真のうち、一番下のセットではカメラを真上と真下に向けることができますが、この状態で撮った真下カットと手持ち撮影の真下カットの両方を素材として使うことになります。

カメラの据付方向

カメラはAPS-Cの場合は必ず縦方向にします。フルサイズは縦でも横でもどちらでも良いです。

| この写真の実際の投稿 松江城 | サンライズのトイレ |

※上のサンライズのトイレはGoogleマップの更新時にリンクが外されてしまいました。

APS-Cでは横が欠ける絵になりますが水平方向に多面撮りしますから十分な重なりが生まれます。

天頂はしっかり円周魚眼のサークル内でカバーできています。

地軸方向(真下床面)は後述の傾きを作るため写りませんがそもそも三脚があるのでこれでOKです。

|

| (失敗例)横向きの場合・・・・ APS-Cでは天頂・地軸方向が大きく欠けるのでいくら水平方向多面撮りしても補えません。 つまり素材として必要な情報が欠落していることになります。 |

パララックスエラー

以下、VR-Headの調整の仕方ですが、これは具体的にはパララックスエラー回避のための調整です。

完全に調整された状態位置のことをノーダルポイントと呼びますが、この位置出しができていないとパララックスエラーとなり、回転軸とカメラのイメージサークル面のズレ(視差)が発生します。

このズレはPhotoSphereとしてどういう現象が起こるのかはこの図を見るとわかりやすいですが、ノーダルポイントが前に出てるとできあがった絵としては空に穴が開いた状態になります。

また、軸線に対しカメラが横方向にズレているとスティッチがうまくいかない場合もあります。

回転軸の中心に・・・(横方向)

具体的なセッティングと調整ですが、先ず最初にレンズの中心と回転軸をピッタリ揃うようにVR-Headの調整をします。 クイックシューのガタつきはとても影響しますから品質の良いクイックシューを使って下さい。

垂直傾斜について

次にカメラをこのように傾けます。

これはあくまでも水平方向◯分割撮り(のみ)の際のセッティングです。

何度傾けるかは三脚の足広げ角度及び使うレンズによりますが概ね6〜7度くらいがいいようです。

私はケースによってはこの角度を一気に15度程度まで持っていくことがあります。

このあたりは色々試して何がどう変わるのか感覚的に掴むのが良いです。

何故傾けるのか…ですが、周囲◯分割撮影した際に天頂部分に重なりをつくることでスティッチソフトが正確に合成を行えるようにするためです。

この傾けはけっこう重要ですから、以下に説明する調整をやった後の撮影でスティッチがうまく処理されない場合はこの傾き角度が浅くなっていないかを確認してみてください。

回転軸の中心に・・・(前後方向)

調整の中では多分これが一番面倒な部分ですが、撮影・検証を何度も繰り返しながら位置の特定になります。

1つはカメラのすぐ近く、もう一つはなるべく距離離した方が良いです。

屋外など広い空間撮影向けにはレンズからの距離:手前50Cm程度 奥側5m以上(奥側はなるべく離す)

屋内など狭い空間撮影向けにはレンズからの距離:手前50Cm程度 奥側3〜5m程度

撮影対象物が全て2m以内に存在する狭い空間の場合:手前10Cm程度 奥側1〜2m程度

※何れの場合も焦点距離が長くなるほどシビアで、Fisheyeではそこそこ適当でもOKですが、そもそもこの調整はFisheyeレンズ向けのものだと考えて下さい。

VR-Head(カメラ)を左右にふります。

装着してるレンズは魚眼ですから実際にはこの絵以上に左右にパンすることになりますが、その状態でも奥側の糸(ポール)が常に重なった状態に見えるように(具体的には)VR-Head上のカメラを前後させます。

【MEMO】

この調整時の左右のパンは何度が良いのかコメントでいただきましたが、(”レンズの水平画角”×”欠け倍率”)÷”水平撮影分割数”×(1.0〜1.5)がおおよその基準範囲となります。

Fisheyeは期待値として概ね180度が捉えられる水平画角ですからそれを基にします。

そしてAPS-Cイメージサークルをはみ出る欠け倍率は0.65前後ですから水平方向4面撮りであればおおよそ±30度〜±45度が調整基準範囲です。

※1.欠け倍率はAPS-Cカメラ&Fisheyeの組み合わせのみに適用する値ですが、厳密にはカメラ・レンズの組み合わせによって差異があります。

※2.高解像度向けに50ミリを使うとするとその計算結果はおよそ3度になるのですが、この左右フリ調整はあくまでFisheye使用による水平方向◯面撮影の場合のみのものです。つまり仰角90度撮影も行う場合は三脚回転軸の直上がイメージサークルのセンターにあるのか確認すれば良いだけとなります。(仰俯角込み多面撮りの場合はカメラ前後位置のシビアさは無視できます)

※3ここでは”水平画角”と表記していますが、カメラを縦固定にするか横固定にするかの違いです。但しサークル状投射となるFisheye前提ですからこの場合、水平・垂直どちらでも同じことになります。

尚、三脚・レベラー・回転台から上の部分が前後できれば良いです。

つまり用意するVR-Headはこれが行えるツクリでなくてはいけません。

ファインダー・液晶画面越しでは追い込みに限度がありますから、実際に撮影してPCの画面上で確認しながら行います。この調整はとても時間がかかります。

話が前後しますがVR−Headにカメラを取り付けてこれらの調整をする際、カメラに付いているこのマークを探してください。これは撮像素子面を示しています。

つまり店頭でLアングルを購入する時やカメラを前後させる微調整の前の荒セッティングとしてこのマークの位置〜レンズ面までの間にノーダルポイントがあることになりますから事前にマークの位置を知っておくとと効率的です。

※目指すポイントがこのマークからレンズ面の間にあるということでピッタリこのマークに合わせてもだめですからそこは実際に確認しながら調整して下さい。実際のノーダルポイントはこのマークよりかなりレンズ寄りです。

※またレンズの性質から言うと、厳密にはこれらの調整でパララックスの追い込みは不可能なのですけれどごく普通のユーザー環境でノーダルポイントを見つける手段が他にはありません。

実際の撮影

以下、レンズは円周魚眼・APS-Cカメラ・上下撮影ナシ水平方向多面撮り…の場合で話をすすめています。

●絞りは概ね8〜11が良いようですけれど、お使いのレンズによって違いがあると思いますから参考程度にしてください。ただ概ねF11からは小絞りボケが出始めます。

●魚眼で絞っての撮影ですからマニュアルフォーカスで∞が基本ですけれど、これも場所によっていじった方がいいケースもあるので参考程度に考えてください。建物内(部屋内)では∞でなく3m程度にしておくと良いです。

※円周魚眼&絞っての撮影ではシビアなピント合わせはあんまり必要ありません。 但し∞以上までフォーカスリングが回る場合は注意して下さい。

この部分は寒暖差対策のあそびですからフォーカスリングを∞以上にすると明らかに遠景もボケます。

●ISOをいくつにするか…ですが、個人的には100がベースでたいていの場合は夜間でも400は超えない設定にしています。今はそこそこ感度あげてもノイズが出にくくなっていますし夜間でもなるべくシャッタースピードを遅くしたくない場所もあると思います。

どのみち感度を上げないでその分シャッタースピードを遅くしてもそれはそれでノイズの原因ですから結局のところはお使いのカメラの性能・特性次第で決めることになります。

●円周魚眼を使っての水平方向のみ多面撮りは最低4分割撮影です。3分割でも大丈夫な場合がありますが重なりが殆どなくなるので写す空間によってはスティッチできない可能性が出てきます。

APS-Cでの3面撮りは失敗する率が高くなります。

また円周魚眼は周囲の画質が落ちますから枚数を少なくするメリットはありません。

それら考慮して4〜6分割撮りが理想です。

●多面撮りでカットごとに露出調整されてしまっては困るためカメラの設定はマニュアルで固定です。カメラによっては純粋なMでなくM相当になる別のモードが用意されていると思いますが、何れにしてもカメラが自動でパラメータ変更しないようにすることが重要です。

まわす方向で暗かったり明るかったり…360度写真撮影ではよくありますが、そのためブラケティングを行います。(下記HDRの項目参照)

●日中、厚い雲が早く動いてる場合…太陽が出たり隠れたりしますが、コントラストの高い影が出たり影自体がなくなったり、一周撮影する間にそういう変化が起きるとスティッチ後の絵に違和感が残るんで注意して下さい。

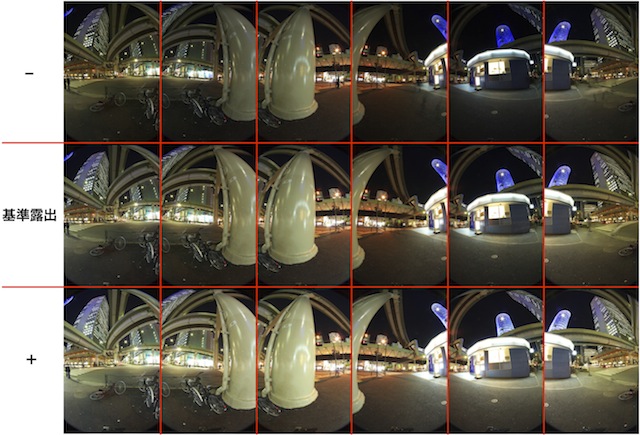

● HDR ( High Dynamic Range )撮影のためのブラケティング

1枚絵にした際のダイナミックレンジを広くする。

何故そうするのかですが、PhotoSphereを環境提供素材と考えるならば不特定多数の受け手がいてそれぞれ写真からなんらかの特定の情報を受けたいと考えている… 但しそれが何なのか(画面のどこに存在するか)は撮影者にはわからない。

つまり、その必要な箇所が黒く沈んでたり白トビしていて情報の受け渡しができなかったら環境提供素材としては意味がありませんから不自然にならない程度に各部の露出を考慮する必要があるため…です。

ブラケティング撮影の設定はカメラではAEB(Auto Exposure Bracket・自動段階露出機能)の表示になっています。

たいていは基準の露出を設定してそれを中心に+○段・−○段というように3回シャッターをきりますけれど、最小/最大EV段や最大AEB・EVレンジ、連写レート等の性能はカメラによって変わってきます。

尚、シャッタースピード・絞りどちらを操作するか選択しておきますがPhotoSphere撮影では全方位に存在するモノが撮影対象になりますから、被写界深度が変に変わると都合が悪いためシャッタースピードを操作する設定で使うことが多いです。

プラス・マイナス何段ズラすかはまわりの風景を見て勘で決めますが概ね-1.5〜+1.5

あるいは±2でおさえる場合もありますが、そのあたりは状況次第で決めてください。

また、ブラケティングの3枚がズレると合わせに大変苦労することになりますから注意してください。

※強風の中で揺れる木々・葉が比較的近くにある空間を撮る場合ですが、、たいていブラケティング撮影中にズレが生じているのでブレンドされた絵はシャープさが落ちています。

ですから場合によってはHDRを諦める必要も出てきます。私自身はそれでも一応ブラケティングでまわしておきますが、その際PTGuiで出力する時にHDR合成されてない状態のものを別々に書きだすモードにして、HDR合成は手作業で行っています。

参考

HDR ( High Dynamic Range )について

●自分自身の影について

PhotoSphereでは空間全部を撮影することになりますが、撮影者が写りこんでしまわないように常にカメラの背後へ逃げることになります。

ただ 屋外の日中では自分の影が画面に入り込まないように撮影時に注意しておく必要があります。

(三脚とカメラの影は仕方ないです)

|

|

つまり撮影の季節と現場に赴く時間帯です。

何れの場合もリモコン伸ばしてカメラの後ろでかがむ習慣があるとミスを最低限防げます。

●RAW

撮影は基本的にはRAWで撮っています。ですから撮影時ホワイトバランスは晴れ固定にしています。

現像時に調整を行う方が確実だからです。

私の場合は現像後は先ずTIFFで書き出しています。

その状態でスティッチを行い、スティッチ後の書き出しもTIFFです。

Photoshopで作業の後の最終段階でJPEGにしています。

(Photoshopで編集中はビジネス案件では16bit扱いにしておくと良いです。書き出し直前に8bitにします。)

何故RAW→TIFFの手段をとるのかと言うと

撮影時にJPEGだとWBの決定を現場で迫られますしその後の処理での画質劣化も気になるからですが、一番の問題は倍率色収差補正です。RAW以外はこの情報がデータから失われるため撮影時にJPEGだとこの調整ができなくなります。

ただ、このあたりは写真の用途や撮り方のスタイルの部分もありますし倍率色収差補正ができるソフトの価格のこともありますから自由に決めて下さい。

私は現像ソフトはSILKYPIXを使っています。倍率色収差補正云々スルーして単純にRAWをTIFFやJPEGにするだけでしたらカメラ付属のものでもOKです。

スティッチ

以前はスティッチソフトは10万円前後からととても高価なものでしたけれど、PTGuiがバージョンを重ね使えるレベルになってきた頃から一気に価格が下がったと思います。

今一番オススメできるのはやっぱりユーザー数も多く解説サイトもたくさんあるPTGuiです。

PhotoSphereはHDRで撮影しますからできればPTGui Proがいいと思います。

使い方について日本語の詳しい解説がネット上にけっこうありますから詳しくはそれらのサイトの方をご覧下さい。

私が使っているPTGui Proはやや古いので、機能不足を補う目的でCubicConverterというツールと併用しています。そのためにOS X10.6にしばられてしまっています・・・

スティッチソフトは何を選んでもいいと思いますけれど、スティッチエンジンの出来によっては苦労するかもしれませんからそこは評判を見て決めて下さい。。

エンジンの出来(あるいは方向性)によっては、例えば室内で4面撮りした際に一箇所が他3面より明らかに明るい時、ブレンド被りが明らかに不自然な絵となります。

その部分でもPTGuiなら概ね安心できると思います。

人気のあるものではもう一つ…Autopanoというものもありますが、これは私自身が触ったことがないので評価できません。評判は良いようです。

スティッチツールは価格が下がってきたとは言え、何れも数万〜10万はしますから趣味で使うものとしての購入には勇気がいりますが試用を利用して目的に向いてるのかどうかを確認してみるといいと思います。

撮影後の手順を簡潔にまとめておきます。

撮影した素材(RAW)→【SILKYPIXで現像】→TIFFファイル→【PTGuiでスティッチ】→Equirectangular(TIFF)→【CubicConverter】→TIFF→【Photoshop】→JPEG

(この一連の作業は何かと言うとPhotoSphereの元となるEquirectangular(2:1)の画像作りです)

※PTGui Proはブラケティング撮影した素材をそのまま飲み込んでHDR処理してくれます。

出力形式・表示方法

実際にインタラクティブに動かして見ることができる状態にするための方法ですが

VRML・JAVA・QuickTime・Flash・HTML5など様々な方法が使えます。

Equirectangular画像を使うものが殆どですが、中には6面(空間を立方体の箱に見立てる)を必要とするものもありますから用途によって画像を用意します。

HTML5としてソースと画像を同時に書きだしてくれるソフトもいくつか存在します。

QuickTimeの場合はスティッチソフトが直接.movファイルとして書きだすようになっているものが殆どなのでjpeg画像云々は関係ありません。

※私は6面書き出しはCubicConverterを使っています。

※過去、360度写真・VRの制作ツールはApple社のQuickTime Authoring Studio(Cubic非対応)を筆頭にQuickTime対象のツールがたくさんあり、360度写真の表示は企業・制作サイドの特別な事情がない限り QuickTime使用が一般的でしたが、現在はWindows環境でのQuickTimeはAppleがサポートを終了しているため非推奨となっていま す。

今後は特に必要がない限り最終出力にQuickTimeを選択することはないと思います。

尚、Googleマップへ貼り付ける場合はjpegのEquirectangularで良いのですが、PhotoSphereXMPを画像内に仕込む必要があるので忘れないようにして下さい。

現在はTHETA用のソフトを使えばこの処理を簡単に行えます。

※現行PTGuiならメタタグ添付されるそうですが、新しいバージョンは持っていないので確認はできていません。

※2016年9月追記 しばらくの間、埋め込みタグ取得ができない期間がありましたが今は直っています。

|

Equirectangular(正距円筒図法)画像。2:1として作られます。これにPhotoSphere XMPを組み込むとGoogleマップ上で使えます。

|

|

| スペーシア個室:Equirectangular |

6面箱展開したもの。 おそらくQuickTime5 CubicVRの影響ですが、最初はこちらが主流だったので360度写真と言えば先ずはこのカタチの画像をよく見かけました。

全天周で撮影された写真を箱展開でなぜちゃんと空間として認識できるのかは以前、仮想世界Second Lifeの中で実験しているので、こちらを御覧ください。

(リンク先の記事について補足説明)

通常、私達はモニターを見ることでその空間を体験することになるので気づきにくいのですが、この状態は視点は常に箱の中心座標で固定されていることになるので違和感なく見ることができます。

仮想世界の中で大きな箱をつくって内側に六面展開されたPhotoSphereを貼って・・・ リアル世界でモニターを見るのと同じ条件にするために自分が中心部にいるのならちゃんと見えるんですけれど、もし仮にその箱の中を歩きまわってしまうと(中心座標から移動すると)途端に空間が破綻してしまいます。

そのため、リンク先の記事では箱の中心座標に座席を作っています。主な関連記事:

● HDRについて

● PTGuiの作業・流れのみを…

● Googleマップへの360度写真投稿の話題

● 底面(nadir)をどうしようかという話題

● タグ(VR)

こんにちは。別件を検索している時に別の方のブログと勘違いしてここにたどり着きました。長文の解説ご苦労様です。今年に入ってからPhoto Sphereを撮り始めたので、「そうそう」と思いながら読ませていただきました。折角なので、パララックスを調整する時の角度を追記していただけないでしょうか?!魚眼レンズのNPは角度依存が有るので、例えば90°回転4コマ撮影の場合、±45°でパララックスを調整するが好ましいのですが、その事を記述しているWebページを見た事が有りません。撮影時の回転角度を前提に調整するのが好ましい事を追記していただけると助かります。

返信削除こんにちは。コメントありがとうございました!

返信削除調整の際の角度ですが、Fisheyeを使用しての簡易撮影の場合、私は6分割・4分割をシーンごとに切り替えています。(1脚の場合は目分量4分割撮りです)

07年以降このての調整を行っていないので正確なところはちょっと忘れてしまっていますけれど、確か30度でふっていたと思います。

一般情報としてNP出し調整時のフリ角度についての数値は当時見たことはありますけれど3〜40度となっていた記憶はあります。

若干、適性から外れる素材になったとしてもPTGuiが飲み込んでくれるのですが、でも確かに基準値というか具体的な角度の表記はしておいたほうが良さそうですね。

具体的な数値は自分で検証を行なってから出そうと思います。

どうもありがとうございました。

こんにちは。返信ありがとうございます。たまたまノーダル忍者の「R1 NPP for Sigma 8mm F3.5 Canon and Nikon」を見つけ、例えば、7.5°上向き時、3回(120°毎)は2.05cmに、4回なら1.85cmに、6回では1.7cmに設定するよう表に書いて有り、NPが角度に依存する事に気づきました。まあ設定数値の違いも数ミリですし、ご指摘の様にPTGuiの調整範囲内だろうと思いますけどね。ところでtontonさんの撮影された写真を見ましたが、仁王門や鉄橋の下、狭い欄干の間などチャレンジングな場所で撮影されてるんですね。恐れ入りました。最近撮影された仁王門正面の写真の撮影年月がプルダウンで2014年9月、2015年5月、2016年6月と選択できるのですが、これはどうやって設定されたのでしょうか?

返信削除Yotarohさん、コメントありがとうございます。

返信削除他国で主流のオモリぶらさげ方法(VRヘッドや1脚すら使わない)とか、、Googleのストリートビューアプリのような撮影方法などソフトエンジン頼りなものを見てしまうとNP出しのシビアさは・・・・ってつい疑問視してしまいますけれど…

おそらくどんなものでも調整は裏付けされた手法やシビアな値があってこその各々の裁量・匙加減でしょうから、このNP関連の調整についてもやはり数値の提示は必要でしょうね。

時間がある時に検証しておきたいと思います。

狭い欄干の手すりのような遠くからカメラの間近まで続く構造体が視界に入る撮影は

確かに視差ズレ起こしやすく、その失敗する可能性の高さは撮影者共通の悩みの種ですね^^;

話としては続いていて・・・これが特にNP調整に強く関わってくる部分ですからおそらくGoogleストリートビューアプリでの手持ちスマホ撮影では失敗率が極めて高いと思います。

やはりNP出し・その調整に時間をかけることは後々の”撮影可能な空間”の選択肢を増やすことにもなりますし単純に楽できるということなのかもしれません。

ところで撮影年月のプルダウンというのが何のことを指してるのかちょっとわからないのですが、

もしかして年月スライダーのことでしょうか

もしそうならば、これは同じ場所で撮影している古いPhotoSphere・新しいPhotoSphere…のように重複してGoogleマップに公開状態にしているだけで特に私の方で設定などは行っていません。

接続は以前はGoogleビューにログインしてPCで行っていましたけれど、ビュー廃止以降現在はストリートビューアプリに頼っていますが、仁王門付近のはアプリのバグのため接続作業を一旦止めたままでした。

接続されてないのに至近距離に同じようなPhotoSphereをアップしてたので勝手に年月スライダー出てしまったのかもしれせん・・・

こんにちは。返信ありがとうございます。

削除年月スライダー、ですね…。なるほど、Google Mapが勝手に設定していたとは…。それなら今まで同じ場所で撮影しようとは思ってませんでしたが、時間軸も撮影テーマに出来そうです。

KITTEの屋上庭園や六本木ヒルズの展望デッキ等三脚不可の場所が有るので、手持ち撮影は習得したいと思っていて、DIYショップで振り下げ錘を買ってしまいました。まだ試していませんが、使えれば遠出の荷物も軽く出来そうです。Florian KnornさんのYouTube「Panorama Tutorial Series」のPhotoshppの変形でつなぎ目の修正をしている大胆さには目から鱗で、Photoshop欲しくなりました…、が、VRヘッドを使った撮影では、登場する機会は少なそうです。

先日、使用するレンズとは違う設定で17mm外側に出した状態で撮影してしまい、どうやっても補正できず、一日の撮影を無駄にしてしまいました。確かに手持ちで撮影して後処理で綺麗に修正できるのであれば、それで十分かもれませんが、今のところ技術が未熟なので、撮影時の手間と安心感、後処理が楽なのがメリットと思い、大きな三脚を持ち歩いて撮影しています。機材が大袈裟なので、撮影時に注目され、カメラ目線の人が増えたり、興味を持った人が話しかけてきたりと撮影に影響する場合もありますが、コッソリ撮影するよりは良いのではないかと思ってます。

ところで、「簡易撮影」との表現を他では見た事が無いのですが、魚眼レンズを使った撮影全般を指しているのですか?それとも水平のみの3~4枚撮影を指しているのですか?

Yotarohさんこんにちは!

返信削除年月スライダーですが、Googleの仕様もサイレントにけっこう頻繁に変更が入っているようですから

特に何のアナウンスもなく機能が追加されていたりなくなっていたり・・・

私達のようにPhotoSphereをGoogleマップにインポートとかは、けっこう際の部分にある機能を駆使していることになるので影響うけやすいのかもしれません。

ですので、この年月スライダーに関する部分も今後その方法が変化することはじゅーぶん考えられます。

この場所この空間をその中心でアーカイブしておきたい!って衝動に駆られる私達PhotoSphere撮影者は、一般の人に比べて三脚使用禁止のエリアに遭遇する率とか影響を受けやすいかもしれませんね。

望遠で離れたところから狙えばOKというわけでもないですし。。

手持ち撮影はHDRや暗所についてデメリットも確かにありますけれどフットワークの軽さも含めてやっぱり強力な武器になりますよね。

私はPTGui ProとPhotoshopを併用してきましたけれど、特に魚眼使用の簡易撮影でない場合は素材枚数が多くなりますし、精細さ精密さが要求される案件ではPTGuiの書き出しフォーマットも32bit・レイヤー・マスクと言った情報を持ったPSDファイルです。

但し、現在そこまで要求が高い案件はかなり少なくなっていると思いますしPhotoshop依存度も以前ほどにはという感じがしますね。

また、PhotoshopのPhotomerge等は360度パンラマ写真合成ツールとして広く知られていますしPTGuiのような専用ツールに大枚使わずに手元のPhotoshopのみで…という方にとっては便利なツールかもしれません。

フォトショッパー向け汎用と言うか、対してPhotoSphere専業の方はPhotoshopは持っていてもこの機能にはそれほど依存はしてないように見受けられますが、、結局のところどのツールを選ぶかは個人ごとの判断によるもので全く問題ないと思います。

簡易撮影という表現ですけれど、、その反対の”簡易じゃない撮影”については今はあまり一般的ではないのでブログ側で詳細な記事は書いていませんが・・・手法を区別するためにあえて簡易という表記を使っています。

魚眼を使った360度球状写真の撮影は前後の2枚のみ(水平方向2分割)で作るものから、現在は4分割・6分割撮影が方法として一般的なのは周知されたものですが、15年ほど前は水平方向3分割+天頂1面が一般的な方法でした。

それと並行してそもそも魚眼レンズを使わない方法がありますが、ここ(http://tonton-meili.blogspot.jp/2016/04/360.html#a2)にも少し書いている通り魚眼レンズより焦点距離の長いレンズを使っての球状写真撮影も方法として存在していました。

こちら(http://tonton-meili.blogspot.jp/2016/04/360.html#a5)の三番目の高解像度…と書いてあるセットの写真がそれです。

地軸面(真下)はVRヘッドからカメラを外して三脚をどけて手持ちで撮ります。

このセットでは4億7000万ピクセルのPhotoSphereがつくれます。

但し、Googleマップへのインポートを主な目的とする場合は現状この精度は必要ないですし、魚眼レンズで描かれる絵の品質面を疑う声をあまり聞かないことを考えると、むしろ現場での迅速な撮影でメリットのある「魚眼使用・水平方向4分割撮り」がこれからもしばらくの間、支持されてるんじゃないかと思います。

360度球状写真の撮影は1995〜2000年あたりはラインスキャン(線状のCCDを回転させて空間キャプチャする手法)が高精細撮影の主流で、これはカメラ自体がロボットのような動きをする機材でしたけれど、この頃はコンシューマカメラを使う方法自体が簡易撮影という区分でした。

ですが・・・・簡易かそうじゃないか…というのは出来上がり成果物の品質に確かに違いはあるものの、

ほとんどの場合は気付かない小さい差異かもしれません。

但し、見たこともないような特殊な機材を持ち込んでるカメラマン…という印象をクライアントに与える営業的な意味合いは… 単価を下げさせないという部分でとても大きかったです。

こんにちは。返信ありがとうございます。

削除魚眼レンズを使った撮影は撮影枚数が少なく簡単に済むので、確かに「簡易撮影」ですね。でも、魚眼レンズを使った写真と広角レンズを使った写真の違いはパソコンなら分かるかもしれませんが、スマホだと判別できるかどうか…。最近はTHETAのような一発撮りのカメラが出て来たので、それを使った撮影の方が「簡易」の様な気もします。

GoogleMapsの仕様がスマホ寄りなのか投稿出来る画素数が14MP~72MPと少な目なので元画像もそれほど頑張る必要もなく、一時期72MPにしてましたが、最近は32MPで投稿してます。とは言え、高画素撮影には興味があり、一度は50mmレンズで撮影してみたいのですが、高画素の特徴を出せる良い撮影場所が思いつきません…。

Photosphereの公開はGoogleがメジャーなので、皆に見てもらうならGoogleMapsの一択かなぁと思っているので、仕様の変更は諦めざるを得ないですね。今年の認定プログラム変更でSVエディタの利用や専用フォーラムに参加が出来ないのは痛かったですけどね。以前から始められた方は痛い目に何回も合われた様で…。

こんにちは!コメントのやりとりが記事本文の見落とし部分の補足にもつながるので大変嬉しく思います。

削除簡易の定義についてはその時点でのスタンダードが何でそれを基準に決めれば共通認識として通じるでしょうから仰るとおりだと思います。

スマホ撮影・THETAに見られれるワンショットデバイスなど比較的安価で簡単に使えるものが出てきている現在の傾向を見る限り、デジイチ+魚眼での撮影は上位に感じますね。

周囲画質の落ちるFisheyeレンズとは言っても、屋外撮影などではちょうどそこに空や雲がくることも多いですし、4面以上の分割数で撮れば画質の落ちない中央付近が活かせますからあとは昨今の高画素デジカメ使用で精細感も確保ということで。。

過去、基準以上の画質と精度を求められたのは官公庁・自動車メーカー・ゼネコン案件くらいでしたので現在のGoogleマップインポートでは、最低基準の画質があるのならそれ以上は迅速な撮影に力を向ける方がいいかなと考えています。

以前はGoogleマップに投稿できるサイズも2MPでしかなかったですから、現在は随分と高解像度の素材がアップできるようになったと思いますが、これもまた数年経てばより高い数値になっていると思うのでとても楽しみです。

ところで、ストリートビューエディッタですがこれはビジネス案件向けにデザインされたツールですから野良撮影にシフトした私個人はちょっと使いにくくてあまりメリットを感じていません。

どうしても、昨年夏に廃止されたGoogleビュー(素材管理・ノード接続サイト)と比較してしまいます。

今Googleはストリートビューアプリに力入れてるようですけれど、ユーザーを振り回さずできれば落ち着いてほしいです。。

今後も方針変更等はあるでしょうね^^;

こんにちは。返信ありがとうございます。

削除以前はGoogleMapsに投稿できるサイズが2MPだったとは…。72MPで投稿出来るようになって感謝、ですね。まぁ、デジカメも最初はVGAでしたから、似たようなものかもしれません。

円周魚眼レンズで4枚撮りをしていたのですが、0°撮りだったせいか、上面の木の葉っぱの引きつりの様な歪が気になり、VRヘッドをここで言う高解像度向けセットに変え、上面も撮影し始めました。紅葉したイチョウやもみじを見上げた時に葉っぱが綺麗に見えるので自己満足に浸ってます、が、見る人には関係ないかも。

さて、高解像度向けセットでの質問です。「回転軸の中心に…(横方向)」はさらっと書かれていますが、具体的にはどのように調整されていますか?下に向けてVRヘッドの中心をライブビューの中心に合わせると多少内側に設定される事に最近気づき、その後外側に移動させながら撮影した画像の合成結果でローテーターが丸く見える位置にしています。これで良いのかどうかは謎ですけどね…。

Yotarohさんこんにちは。

返信削除ちょっとネットのない環境に数日間行っていたので返信が遅くなりました。

普段の屋外撮影では空にあたる天頂方向は無視しがちですが、上面撮りのメリットは確かにありますね。

見上げた時にしっかり意図したものが撮れているとやっぱり空間撮影自体の質もあがると思います。

不特定多数の閲覧者が各々特に何を見たいのか撮影者にはわからない空間撮りでは特にそうなのでしょうけれど、それでもやっぱり撮影者としてのコダワリの部分は1枚ごとにありますねー

それを無くしたらストリートビューカーの自動撮影と一緒になってしまいますし・・・・

ご質問の件ですが、レンズの中心と撮像素子の中心というかライブビューと実際に捉えてるセンターが微妙にズレているという現象は調整を行った数台のカメラで確認していましたけれど、それらをふまえて結局は目分量です。

具体的には先ず天井から吊り下げたオモリ付きの糸と回転軸の中心をあわせておいてから、次にFisheyeのフートキャップのセンター出し(印付け)しておいたトコに合わせて・・・

そのあとは広い場所で前後調整を行うという方法です。

それでも最終的にスティッチソフトの方でカバーしてくれていたので、これで良しという判断なのですが、最初の頃はどこまで大きく横にズラしたらどういう空間でどんな合成破綻を起こすのかラフな調整への耐性みたいな部分の検証は繰り返していました。

ネジの緩みなどによる理由で、固定が緩くなっていることに現場で気付き即席目分量調整を行うというケースも2、3度ありました^^;

ですから合成結果でロ−テーターが丸く見えているのならそれはじゅーぶん最良の位置に近いと思います。

こんにちは。返信ありがとうございます。

削除以前山頂の茶屋の主人にGoogleフォトの写真を見せようとしたら、圏外で断念したことが有り、何気なく使っていたツールがインターネット前提だったと思い知らされました。また、地方に旅行に出かけた時、観光地の近くでも圏外になったので、まだまだ通信できないところが有ると驚きました。何日もインターネットに接続できない環境で過ごされたとの事、違う世界が見えたのでしょうか!?

さて、合成結果による調整ですが、何か所か撮影したところ、下側は完璧なのですが、綺麗に撮りたい上方のステッチミスが出やすくなったような気がするので、0°で調整する方法に変更しようとしています…。

紐をつり下げて調整するとは思いつきませんでした。アナログではありますが、良さそうですね。とは言え自信がないので、紐をレンズに付けて錘をぶら下げると上手く中心を示してくれるのではないかと試してみましたが、思いの外紐の摩擦が大きく、錘が上手く真下に来ないので、断念しました。

調整がそこそこ上手く出来ていれば、後は撮影時の環境の影響だろうとあきらめがつくので撮影に集中できるので、何とか良い調整方法が見つかると良いのですが…。

ところで、今のところカメラから1m位の物と2m位の物で視差調整をしています。魚眼レンズで有ればなんとかなりますが、24mmとか35mmの広角だとピントが合わないので難儀しています…。屋外で前後調整されたとの事ですが、対象との距離はどの程度にしてますか?また、調整後に撮影して追い込んでいるとの事ですが、どのようなことをされているのでしょうか?

削除こんにちは!今の時代、ネットインフラはあって当たり前というか、生活にとけこんでいますから普段どれくらいそれに依存してるのかもも忘れちゃっていますね。

確かに私も今はGoogleフォトでPhotoSphereをはじめ普通の写真もそこに置いて管理していますし、これネット繋がらないと全くアクセスできなくなりますねー

PANORAMAヘッドまわりの調整ですが、本当に試行錯誤の繰り返しですよね。

案件ノクオリティ・撮り方のスタイルとか撮影後のプロセス・使用カメラ・レンズはもちおん、厳密には広い空間(屋外)・狭い空間(屋内)でも変わってきますから汎用的にオールカバーできるセッティングはないと思いますが、、

結局はどのあたりの追い込みで妥協するのかということなのかもしれません。

私はこのところGoogleマップにアップするものばかりになっていますが、これは特に”接続”を意識するため(数を撮るため)迅速さを優先していますから、APS-Cカメラ+Fisheyeレンズでの水平4面または6面撮りのみとしていて、フルサイズ+通常レンズでの真上撮り・真下撮りを含むような55面撮りは最近行っていませんが、その分PANORAMAヘッドの調整も一度時間をかけてちゃんと調整を行ったあとのメンテ等はかなりラフというか割り切っていて、、、だからこその現場目分量調整でオッケーというような気楽さを得ています。

Fisheyeでの水平方向のみのフリですから天頂がかぶるようにカメラを7度程度上へ傾けていますが、概ね大丈夫なものの、やっぱり100%OKというわけではなく、細い樹の枝が真上にたくさんあるような空間では稀におかしくなっている箇所もあったりします。

さて、視差調整ですけれど前述のように狭い空間向け・広い空間向けによるセッティングに関係してくる部分なのですが、Fisheyeより焦点距離の長いレンズではここが特に肝になってきます。

自動車メーカーのサイト用に車内を撮る案件があった時、レンズ端30Cm・1mでの調整でしたが、広い工場内を撮る際または屋外撮影用にはレンズから1m・10mくらいで調整を行いました。

屋外向けなどは手前用にはオモリをぶら下げた糸と離れた場所にある電柱を利用しました。

もちろんシビアな調整はカメラのモニターでは確認が無理ですからIEEE1394接続のPC画面上でリアルタイムに絵を確認しながらの視差調整を行っていました。

Fisheye使用を含めなるべく汎用に使えるセッティングということで現在主に使っているパノラマヘッドは50Cm・5mでの視差調整で行っていますけれど、こちらに関しては特に裏付けデータがあるわけではなく感覚的にこれくらいでやっておこう…という理由が全てです^^

撮影対象物が全て2m以内に存在するような空間の撮影でない限り、手前側と奥側のポール/糸はなるべく離すというのがベストな状態ですから、そこから出した「雰囲気」の値です。

こんにちは。返信ありがとうございます。

削除全てを満たすセッティングは有りませんかぁ…、まぁ、そうですね。カメラを上下に振っただけでズレてくるのですからね。カメラを軽くした方が効果あるかもしれません。

久し振りに、撮影場所の記録のために魚眼レンズ4枚撮りをしたのですが、撮影も合成も楽ですねぇ…。空が開けている場所なら、これで十分ですよね。

視差調整ですが、遠方は5m以上離れたところを使うのですね。広角レンズ、今回は18mm-35mmの24mmが上手く調整出来ていなかったので、早速手持ち撮影用に準備していた錘を80cm位に吊り下げて遠方のマンションの避雷針と紐を合わせてみました。窓を開けていたら風で錘が揺れるので窓を閉めました。紐を使って屋外で調整するのは風で揺れるので難しそうですね。フォーカスは避雷針に合わせて絞りを絞り込んだところ、紐が多少ボケる程度で避雷針との位置合わせが何とか出来ました!!!室内からだと角度によってライブビューの明るさが変わるので以前は諦めていたのですが、露出補正で表示の明るさも調整できました…。この結果、18mmと35mmの調整は同じで正しく、24mmは前後と横方向がズレている事が確認できました。ズームの位置によってNPの位置が前後だけではなく横方向まで変わるとはね。フォーカスの位置によってもNPの位置が変わりそうですが、避雷針までは50m以上離れているので屋外撮影用に上手く調整できた気がします。この設定でテスト撮影してみたところ、以前は途切れていた送電線もバッチリ繋がりました、感謝!!夏でも冬でも空調の効いた部屋の中で調整できるので嬉しいです。他のレンズもこの方法で確認してみます。

そうそう、フルサイズはライブビューで19倍まで拡大できたので、位置合わせはライブビューで確認しました。APS-Cは8倍程度なので、もしかするとPCが必要になるかもしれません。

撮影枚数が増えたので、0°→上の方→下の方と撮影すると、影が激しくずれてしまうので、上から順に撮影した方が良さそうです。また、三脚消し用画像の撮影は良いのですが、冬場なので特に影が長く、影消し用の画像の撮影は画角が狭いので、まだ穴が開いてしまいます…。こればかりは慣れが必要ですね。

さて、視差調整で左右に振った時、24mmでは右と左で位置が前後しました。今回、この場合は横方向がズレていると考えて横の位置を調整して左右中央を合わたのですが、左右に振った時の違いって横位置のずれと考えて良いのでしょうか?

こんにちは!

削除先ず最初に、遅くなりましたがコメントで一番最初に話題に出ていた左右フリ角についてレンズメーカーの知り合いから技術情報を得ましたので追記しておきました。

http://tonton-meili.blogspot.jp/2016/04/360.html#b1

さて、これにも絡む部分で上のアドレスの”MEMO”の方でも少しふれていますけれど

Yotarohさんも天頂方向撮影をされているようですので話を整理する意味でも参考までに私がやっている調整の種類について書いておきます。

私はこのNP出し調整での左右フリはFisheyeセットでのみ行っていて、天頂方向も撮影する「高解像度撮影」セットでは”MEMO”に書いた通り左右フリではなく天頂を向けたカメラが捉えてる絵の中心点と回転軸を合わせる方法を使っています。

具体的には天井に印をつけ、そこからオモリ(建築等で使われる位置出し用の下が尖っているオモリ)をぶらさげた糸を垂らして三脚の開店中心軸にあるネジと合わせた後、カメラをセットして真上に向けて天井の印が絵のセンターに来るように前後左右の位置調整を行う・・・という方法です。

この方法の調整は15ミリ・24ミリ・50ミリで行ったことがありますが、つまり天頂撮影を行うセットの場合についてはこの調整を行い、唯一…仰俯角0度水平方向のみ撮影でOKなFisheyeでのみ左右フリによるNP出しを行うということになります。

※上から垂らしたオモリと三脚回転軸を合わせただけではNPにはなりませんが、これはNP近くへ導くための前段階調整ですから最後は天頂を向けたカメラが捉えてる絵の中心に天井の印が来ることがゴ−ルになります。

天井の印=三脚回転軸 …の前提を作っておいて、そこからNP出しの微調整をしていくというプロセスです。

※但し更に精度を求める案件撮影(空間内の被写体全てがパーツレベルでの正確さを求められるものに限り)の場合は最終段階として左右フリ調整を行って厳密に合わせたことがあります。

それにしてもほんとにNP調整には苦労しますよね。

仰る通りレンズの焦点距離によっても(特にズームレンズでは顕著)最適値にズレが生じますから、うちではレンズ・カメラ・PANORAMAヘッドの3点は常に固定のセットとして個別に持っています。

それはそれで便利なのですが、重複して複数管理するのもやはり面倒ですし最近はGoogleローカルガイドとしてFisheyeでの数撮り傾向が強いので使用しているのはFisheyeセットばかりです。

そう言えば今のフルサイズはライブビューで19倍も拡大できるんですねー

うちのはやや古いモデルのためわざわざPCモニターに絵を流していました。

左右に振った際に右と左で位置が異なるのはカメラ位置の横ズレの可能性が大きいと思います。

フルサイズで24ミリの場合、水平方向撮影枚数にもよりますがNP出し調整での適性フリ角度は±6〜9度となりますが、これが例えば±30度とか極端に大きいフリ角の場合”本来合わないもの”を左右どちらかについてのみ強引に合わせてしまってるのかもしれません。

こんにちは。返信ありがとうございます。

返信削除おっ、過去記事修正できるのですね!

ライブビューは、取説には19倍と書いて有るのですが、液晶の画素数からすると6倍位で等倍のはずなので、残りは何なんでしょうね!?でも大きく出来るので調整には便利です。

3点固定セットですか…、確かにそれなら確実ですね。最近はフルサイズでパノラマ写真も普通の写真も撮っているので、設定の変更と荷造りが少し煩雑です。本当はAPS-Cをパノラマ専用にしたいのですが、APS-C用の広角単焦点レンズが無いので踏み出せていません。レンズシステム変更にまで手を出すかどうか…。

24mmの撮影は、垂直画角が53°なので45°回転8枚撮影です。広角レンズなのでNP位置の角度依存は無いと思いますが、用心の為、隣の絵との継ぎ目の位置にあたる±22.5°振って視差調整してます。左右に振った時の違いについては、確かに何とも言えませんよね。もう少し考えてみます。

あっ、そう言えば、24mmでの撮影はピッチ0°、45°、-45°共に8枚撮影しているのですが、上と下は60°回転とかにして撮影枚数を減らせそうな気もするのですが、どうされているのでしょうか?

上方の印による回転中心出しは理解できましたが、その後のNP出しを左右に振らずに行う微調整の手順と原理が良く理解できませんでした…、申し訳ない。

返信削除こんにちは。ここも随分コメントの数が増えてきて記事全体の補完になり嬉しいです。

24ミリ周囲45度フリ8面撮影前提だとNP出し調整は±6.6〜10度になりますが、技術データ上での理論値でしかありませんからそれは多分光学的な保証も含んでるんだと思います。と、いうよりメーカーが裏付けのない雰囲気値を出すことはないので±22.5で支障が起きていないのでしたら特に問題はないと思います。

PhotoSphere撮影・画像処理はどちらかと言えばソフトウェアに頼る部分が大きいですから

通常の「写真」のための撮影機材などハードウェアを提供する側に蓄積された検証データはそれほど多くはないと思いますから最終的には私達撮影者の匙加減で最適値を割り出していくしかないのかもしれません。

仰俯角による周囲分割数ですが、もちろん上と下を60度回転など、撮影枚数を減らすことは問題ありません。

リアルのPhotoSphere撮影の話題ではありませんが、以前書いたブログ記事にもこの話題にふれています。

http://tonton-meili.blogspot.jp/2016/06/second-life360_29.html#a1

使用するローテーターにストップ機構がある場合はそれを活用すれば楽ですね!

こういう撮影の場合、私はManfrotto 300Nを使っています。

さて仰俯角多面撮り(真上を含む撮影)の場合でのNP出し調整左右フリをやらない理由ですけれど

もちろんやること自体に問題はありません。

先日のコメントでも「※但し更に精度を求める案件撮影(空間・・・」と書いていますが、やらないよりはやった方が良いです。

但しスルーでもOKという意味なんです。

NP出し左右フリ調整はご存知の通りカメラの前後位置(回転中心軸)とイメージサークルを合わせるためのものですが、これが特に必要なのは仰俯角0度の1ショットで真上〜真下まで撮ってしまうFisheyeの場合で、、スティッチ上のパララックスエラーを回避するためのものですが、

例えばこの図 https://goo.gl/photos/ircwNpEo8XvmY5U36 のように回転軸からカメラが大きく前に出ていたとして空間撮影の成果物に問題が出るのか?ということなんです。

この図を見てアレと同じだと気付かれたと思いますが、Googleストリートビューカーのカメラユニットとそっくりです。

また、ストリートビューアプリを使って手持ち撮影する場合でも、自分の身体(足元)を回転軸とイメージしてまわしていくのでこれと同じ感じになっています。

もちろん、私自身もこの図のような極端な設定は行いませんし

なるべく撮影時の水平360度回転・仰俯角-90〜+90度の回転中心がカメラのイメージサークル面に来るように配慮した調整を行います。

でもそれほど追い込まなくれも問題はないということですね。

まとめますと、天頂撮りのある仰俯角多面撮り用のセッティングでは回転中心からイメージサークルの距離はそこそこ適当で良いですが、芯のズレはスティッチ失敗を招くの調整時にで天井の印・カメラが捉えてる絵の中心を合わせるちう部分が重要になります。

また当然ながらPANORAMAヘッドがリンク先の図のような期待した通りの動きができる機構のものでないといけません。

唯一この調整が成果物の出来を左右するのは、すごく狭い空間内での撮影です。

こんにちは。返信ありがとうございます。

削除久し振りにWindowsのブルースクリーンを見てしまいました…。WindowsXPの時は良く見ましたが、最近は見てなかったので油断してました。Window10はエラーの詳細URLをQRコードで表示するのですね。リブートできず、手こずりました…。仮復旧中です。

確かに真上の画像は大抵の場合、空と雲だけなので、上を向いていればOKな場合が殆どで、水平+真上の場合はそれで良いのですが、今回は紅葉したイチョウやカエデの葉の形をはっきり出したかったので枝がそこそこ近く、やはり左右に振ってNPを合わせておかないとソフトの処理にも限界が有り、合成時に枝がズレて、残念な絵になってしまいます。仰俯角多面撮りの場合は調整がアバウトでも良いとの事ですが、どちらかと言うとこのような撮影をしたくなるのは綺麗に撮りたい場合なので、入念に調整した方が良いと思います。

ですので、図の様にカメラを配置すると遠方は良いのですが近場はステッチエラーが出まくるので、成果物は問題りです。あぁ、今回の被写体からすると、です。すごく狭い空間内での撮影の場合と同じですね。

今回の経験から言うと、回転軸からの横1mmや前後1mmのずれも最終的な絵に影響しましたので、追い込みは必要と感じてます。今のところ、1mm単位で追い込んでいますが、合成結果からみるともう少し、0.5mm単位で追い込むとより良くなりそうな気がしてます。

パノラマ撮影は撮影時に結果が分からないので、ある意味昔のフイルム撮影と同じですね。現像して結果が分かる->合成してみて結果が分かる。人が多い所で撮影すると、思わぬところに人が写っていて、下側の画像に足元が無い、影が無い、とか、信号待ちで止まっていたはずの車が一周回っている間に居なくなる、とか…。

こんにちは!

削除ブルースクリーンですか・・・ 普段私はMacなのでWindowsのブルースクリーンを見る機会はあまりないですが

そういえば、Macに入れてるもうひとつのOSはまだWindows7のままでした^^;

仰俯角多面撮りについてですが、これは確かにキレイに撮り残す案件向けの撮影方法ですから

できるだけ調整の部分でベストな状態にしておきたいですね。。

とは言っても具体的な指標というか回転中心点とNPの関係・あそび許容についてデータらしきものは見たことがありませんが、

回転中心点からイメージサークルのあそび距離は、0に近いほど精度が出せていることには間違いありませんし

同時に主対象物までの距離によってあそび範囲に余裕が出てくるというのもやはり正解なので

極端な話、過去に宇宙VRと呼ばれていた天球写真撮影のあそび距離は地球の半径でした。

前回のコメントでも似たようなことを書いていますが、主に何を撮るのが目的なのか、その傾向によって各々の匙加減で追い込み具合は決めてしまって何ら問題はありませんし、中心点との距離を0に近づけて精度を出しておけば仰俯角多面撮りセットとしては一応の汎用性を得たことになるのでシビアに追い込んでいくというスタンスのもと、試行錯誤で最適値を出していくのは本来のNP出しそのものの考えかただと思います。

このブログ記事の本文中に貼ってある「高解像度セット」はここで話題にしてる仰俯角多面撮りの機材ですが、全対象物2m以内撮影向け案件の際につくったものですから、これの調整には左右フリまで行っています。

ミリ単位でどうかとかは考えたこともありませんが、試し撮りを重ねた結果このへんでいけるな〜という判断で調整完了させてますね。

私自身は仰俯角多面撮りで失敗したことは今迄ありませんしメーカーの大勢のスタッフが準備のために動く仕事案件が主でしたから”失敗したので後日再度…”ということは許されませんが、自分なりに”失敗しない”と言えるものは、、広い空間でも極めて狭い空間撮影であっても被写体の人工物比率が高い場合であれば…です。

逆に言うと風で揺れ動く可能性が高い屋外の密集した林の中・近接での樹の枝・葉はFisheye水平4面+上面のセットの使用にするとか、、撮影枚数を少なくする方向で考えます。

今は完全に趣味活動ですから大雑把さに拍車もかかってしまっていますが・・・

尚、仰俯角多面撮りの素材の処理(スティッチ)の場合のみ・・半分以上手作業となるDeFishという古いソフトを主に使っていました。(最近起動していないのでコンディションが不明ですが)

そうですね〜 人や車が多い場所での撮影・・・

Fisheye水平4面撮りが一番失敗しないでしょうけれど、それでもタイミング次第では変な絵が合成されることはありますね。

余裕があれば同じ設定でもう1周まわしておけば確かにレタッチ時に補完しあえる素材を得ることはできますけれど、何度かやった感じでは…撮影地点的にその成果物がすごくいい写真!…になる率はそんなに高くないのに作業には時間がかかるみたいな部分で・・・ちょっと面倒にも感じました^^;

こんにちは。返信ありがとうございます。

削除紐を使った視差調整が気に入ったので、魚眼レンズで試してみました、が、広角レンズと違って小さく写るので、調整が難しかったです…。

コメントの「さじ加減」を見て気が付きました。大体この程度に合わればこの場の撮影には十分と今までの経験に裏打ちされた表現なのですね。でも、初心者は経験がないので、大体とか適当の加減が分からないので戸惑います。料理でもプロはこの位としか言わなかったものを小さじ1と表記することで、誰でも概ね同じ味に仕上げられるようにしたのと同じで、手取り足取りの説明が嬉しかったりします。

極端な話で思い出しました。東京タワーや京都タワーから見た景色を見た事が有ります。随所で細かな破たんは有りましたが、あれを見たら一度どこかで挑戦したくなりました。

最近購入した上下にも回せるパノラマヘッドもここでのやり取りを参考に調整し、実際の撮影を始めました。取りあえず調整は何とかなりそうなので、今後の課題は撮影後のRAW現像です。最近やっとレンズ補正に気づいたばかりで、ハイライト、シャドウ、白レベル、黒レベルって何なの…、と言った状態で、まだまだ先は長そうです。

ではまた。

こんにちは^^

削除調整の時のサジ加減という表現は確かに曖昧さしかありませんね・・・

感覚的な表現ばかりになってしまいますが、カメラ・レンズ・PANORAMAヘッド部材…etc それぞれ手持ちのものによってとか、やりやすさとか我流とか・・・何かしら変動要素が入ってくると思うので断定的な説明が入り込み難い部分なんだと思います。

私自身も始めた当時は確実な情報を得たいとは思いましたけれど、

その当時の360度写真撮影はApple QuickTime依存度が高かったですからWindowsユーザーにはあまり浸透していなかった…と、いうかMac世界内の技術・・みたいな印象が強かったためやってる方が少なかったですし、

何よりスティッチソフトが非自動だったせいで受け付けてくれる素材に対して許容があまりないというか…

ですから こういう空間ではこういう調整を行って撮った素材がうまく繋がる というような試行錯誤の繰り返しのなかで習得した感じはします。

それは多分に思い込みも含まれていた筈ですし、こういう感覚的なものを数値情報として第三者に伝えるのは難しいのかもしれまぜん

私がここのブログ記事で書いてる内容はプロセスの紹介をメインにしようという意図がありましたから

最初は具体的な数字を明示していなかったですが、やはり調整について最終的には個人ごとのやり方・感覚・妥協もろもろ入ってくるんだと思います。

さて、360度写真撮影をデジイチでやろうとすると機材にかかるコストもさることながら、

現像ソフト・スティッチソフト・レタッチソフトを用意しないといけないですし、それぞれおぼえるのも大変な面ありますね。

現像ソフトはカメラ付属のでもいいですし、スティッチソフト・レタッチソフトはフリーのものもあるので、この3点については費用かけない選択もできますけれど、、

作業量の軽減とか撮影の守備範囲を広げたいとか欲を出すとどうしても、

現像にはSILKYPIX、、、スティッチにはPTGuiPRO、、レタッチにはPhotoshop・・・と、コストかかっていくことになるので、どのあたりまで出していけるのは各々の判断だと思います。

例えば…「RAWで撮って色収差補正も行いたいので現像ソフトにSILKYPIXはほしい

そして、HDR素材をPSDでレタッチにまわしたいのでPTGui proとPhotoshopの連係は必須・・・」 こんな感じでしょうか。

ただあえてこの3点に優先順位を付けるなら、最初に用意するのは間違いなくPhotoshopだと思います。

デジタル写真を扱う以上は必須ソフトみたいな、、このあたりはPCで写真を扱う方にとってのデフォルトでしょうし所有率は普通に高いと思います。

Photoshopや現像ソフトはフィルム現像〜紙焼きのデジタル化ですから、操作についてもそのシミュレーションが行えないといけませんが(アナログ時代の知識が必須ですが)やはり便利だと思います^^

Wataruさん、はじめまして!

返信削除コメントどうもありがとうございます^^

最近はTHETAなどのワンショット機材も出てきてけっこう賑わっていますけれど

それと同時にデジイチでパノラマ撮影する方も増えているようですから、今後しばらくの間色んな話題や技法が出て来るような気がしてて個人的にも注目しています。

また何かありましたらコメント下さい^^

この土手は江戸川堤防天破道路ですね。(千葉県側は野田サイクリングロードの名称が付けられていますが)

車と並走しないで短時間に地域エリア間移動できるので重宝しています^^

はじめまして、パノラマ写真に挑戦中の者です。

返信削除各ページを参考にさせていただいております。

質問なのですが、底面を撮影せずに一つの場所で4方向撮影しておりますが、Ptguiを使用して

加工すると底面が黒塗りになってしまいます。

https://tourmake.it/ja/tour/b7515983531dc03a0e5af771243b1096

のように底面を撮影せずに、三脚部分を周辺の画像から絞り込む様にするにはどのように

すればよいのでしょうか?

お手数をかけますが、ご指導のほどよろしくお願いいたします。

いとうべっくさんはじめまして!

削除コメントどうもありがとうございます^^

PTGuiでstitch後に底面が黒塗になるのは水平4面撮りでnadir情報が欠落しているからですからこの状態は正しいのですが、そこからの処理をどうするかは悩みますね。

この底面をどう処理するかはいくつか方法がありますけれどPhotoshopにsuperCubicプラグインを入れてる方・あるいはGIMP2.8にG'Micプラグインを入れてる方に二分されてるような雰囲気を感じています。(私はそのどちらも使っていませんが)

ご質問の地軸への絞り込み効果ですが、LGCの底面処理のスレを確認したところ、GIMPの”渦巻と吸い込み”で処理しているみたいです。

そこで紹介されているJun_Kinoさんのブログへ直リンク

https://junk0128-jpn.blogspot.jp/2017/05/gimp-nadir.html

尚、Google LGCの底面処理に関する日本語情報のスレッドはこちらです(アクセスできない場合もあります)

https://www.localguidesconnect.com/t5/Street-View-trusted/Tips-Nadir-%E5%A4%A9%E5%BA%95-%E3%81%AE%E5%87%A6%E7%90%86%E3%81%AB%E3%81%A4%E3%81%84%E3%81%A6/td-p/243249

ご丁寧なご回答ありがとうございます。

返信削除https://junk0128-jpn.blogspot.jp/2017/05/gimp-nadir.html

を参考にやってみます。

改めて質問なのですが、1方向についてホワイトバランスを3段階で撮影、計12枚の写真を

撮影し、PTGuiにてステッチすると、ぼやけた、かすんだりしてうまくパノラマが作成できません。何かアドバイスがあればご指導いただければ幸いです。

こんにちは^^

削除まずWBブラケットは使用しない方が良いです。

パノラマ撮影で必要とされるブラケットは、あくまでHDR前提ですから露出ブラケットになるのですが、、

PTGuiもシャッタースピードの変化を読み取ってHDRモードに移行するようにできています。

Aligin images…を押した際、正常にHDRモードに移行するとこの画面が出ます。

https://goo.gl/photos/3CCHUy9izuMgGfuc6

この画面が出ていない場合PTGuiは4面素材でのスティッチを試みようとしていますが(でも余計な素材が他に8枚あることになるので)スティッチでのノイズ源となります。

※露出ブラケットにしていてもカメラの内部エラーでシャッタースピードの可変が行われないことが稀にありますが、このケースのPTGui出力も ぼやけた・かすんだ絵が出来てしまいます。

この場合はHDRは諦めて基準露出のみを選んで(4面撮りの場合は4枚で)スティッチすることになります。

WBブラケットされてるということはJPEG撮りされてるんだと思いますが

ホワイトバランスはどれか一つに決めて撮影を行ってみて下さい。

もちろんWB AUTOモードは失敗します。

個人的にはRAWで撮って現像時にWBを…というワークフローが好きですが

JPEGで撮ってる方もけっこういらっしゃるのでそこはやりやすい方法で良いと思います。